Les entreprises s’immergent de plus en plus dans l’intelligence artificielle (IA), mais l’adoption rapide ne se fait pas sans accrocs, notamment au niveau juridique. En 2025, la jurisprudence témoigne d’un tournant significatif : le Droit de l’IA s’impose désormais comme un volet incontournable du dialogue social et des obligations des entreprises technologiques. L’ordonnance rendue par le tribunal judiciaire de Nanterre impose de nouvelles règles strictes aux employeurs, faisant de la consultation du Comité Social et Économique (CSE) une étape obligatoire même pour les phases pilotes d’outils IA. Cette décision redéfinit les contours de la conformité légale autour de l’innovation juridique liée à l’IA et pose les bases d’une responsabilité des entreprises renforcée dans la transition numérique.

Habitué au story des 15 secondes ? Voilà ce que tu dois retenir :

- ✅ Le déploiement d’un outil IA sans consultation du CSE est déclaré infraction et suspendu.

- ✅ L’expérimentation interne est considérée comme mise en œuvre effective, non simple test.

- ✅ Les entreprises doivent anticiper le dialogue social et fournir une documentation complète.

- ✅ Le Droit de l’IA devient un pilier de la protection des données et de l’éthique technologique en entreprise.

Un tournant juridique : quand l’intelligence artificielle en entreprise devient un sujet social

L’affaire jugée par le tribunal judiciaire de Nanterre illustre à quel point la jurisprudence numérique est en train de redéfinir le cadre légal autour de l’intelligence artificielle en entreprise. Ce n’est plus une simple avancée technologique à déployer en douce. L’IA, en tant qu’élément structurant l’organisation du travail, doit impérativement passer par le filtre du dialogue social, incarné ici par la consultation du CSE.

Dans ce dossier, une entreprise technologique a lancé un système algorithmique impactant les salariés, sans faire appel au CSE malgré ses demandes répétées. Le CSE a directement saisi la justice en référé. Résultat : la justice a décidé de stopper net le déploiement et a sanctionné financièrement l’employeur pour violation des droits du comité.

La portée de la décision et ses implications

Le tribunal s’appuie sur l’article L.2312-15 du Code du travail. Une formulation clé clarifie que même la phase pilote doit être considérée comme une mise en œuvre officielle. Cette nuance est décisive, car elle signifie que l’expérimentation ne peut plus être le prétexte pour écarter la consultation du CSE.

En pratique, cela impose aux entreprises :

- 📌 De fournir au CSE une documentation complète et écrite.

- 📌 De laisser un délai raisonnable pour examen et délibération.

- 📌 D’intégrer le dialogue social avant toute opération d’implémentation.

L’absence de ces étapes vaut désormais entrave aux prérogatives du CSE, justifiant sanctions et réparations financières. Un changement brutal qui interroge sur la place nouvelle attribuée à l’éthique technologique et à la protection des données dans ce cadre.

La responsabilité des entreprises au cœur de la régulation IA

L’impact de cette ordonnance dépasse le cas précis. Au moment où la transition numérique accélère dans tous les secteurs, les directions générales et les directions des ressources humaines (DRH) doivent repenser leur stratégie. Le Droit de l’IA inscrit la responsabilité des entreprises dans un cadre clair et exigeant.

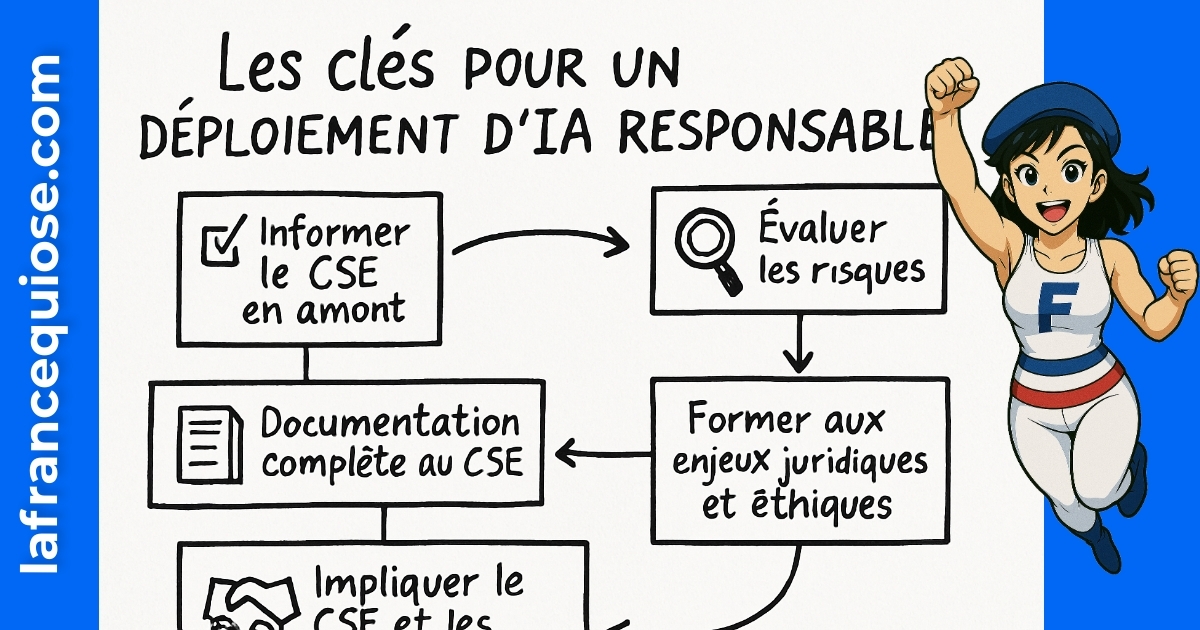

- 🔍 Évaluer les risques liés à la mise en œuvre d’outils IA et leurs incidences sur les conditions de travail.

- 🛡️ Garantir une transparence totale sur les données personnelles traitées.

- 🧑🤝🧑 Impliquer systématiquement le CSE et les représentants du personnel.

En résumé, cette décision souligne que l’IA n’est plus une simple technique de pointe, mais un levier organisationnel qui doit être gouverné selon les règles du droit social et des innovations juridiques protégeant les travailleurs.

À lire également :

Trackr.fr Tech : LA solution de tracking idéale ?

Perdre un objet important, c’est vite frustrant et chronophage. Aujourd’hui, la technologie de tracking s’impose comme un outil indispensable. Trackr.fr Tech, avec ses solutions innovantes,…

Conformité légale, dialogue social et protection des données : les règles à suivre sans faute

Entrer dans l’ère du Droit de l’IA oblige les entreprises à prendre au sérieux la conformité légale autour de leurs projets d’intelligence artificielle. Une start-up qui déploie un chatbot ou un algorithme d’analyse automatisée ne peut plus balayer d’un revers de main les exigences du Code du travail et des réglementations sur la protection des données.

Les étapes incontournables pour éviter les litiges

La jurisprudence récente impose une discipline rigoureuse dans la gestion des projets IA :

- ✔️ Informer le CSE dès les premières phases, y compris pour les tests internes.

- ✔️ Fournir un dossier détaillé couvrant les usages, finalités, nature des données et critères de décision automatisée.

- ✔️ Garantir la protection des données personnelles selon les règles GDPR et leur adaptation spécifique à l’IA.

Sans cela, l’entreprise s’expose à la suspension de l’outil, à des amendes, et à la dégradation du climat social. Cette attention portée à la conformité permet aussi d’éviter les dérapages éthiques liés à l’automatisation des tâches et la délégation de décisions aux machines.

Documentation et transparence : les piliers de l’innovation juridique

Pour protéger l’entreprise, et ses salariés, les équipes projet doivent documenter :

- 📄 Les finalités précises de l’outil IA.

- 📊 Les types et sources de données traitées.

- ⚙️ Les critères qui fondent les décisions automatisées, avec leur potentiel biais.

- 🛠️ Les mesures d’accompagnement prévues en cas d’impact sur les conditions de travail.

L’absence de transparence met en péril la confiance des salariés et pose un risque réglementaire majeur. La gestion des données, en particulier personnelles, est un véritable enjeu de conformité légale qui conditionne la réussite de la transition numérique.

| Aspect clé 📌 | Obligation légale ⚖️ | Conséquence en cas de manquement 🚫 |

|---|---|---|

| Consultation CSE | Obligatoire même en phase pilote selon L.2312-15 Code du travail | Suspension de l’outil, astreinte financière, sanctions |

| Documentation complète | Doit permettre un examen éclairé par les représentants du personnel | Recours judiciaire, perte de confiance sociale |

| Protection des données | Respect RGPD et contraintes renforcées d’IA | Amendes, sanctions CNIL, atteinte à la réputation |

La co-construction de projets IA éthiques comme avantage compétitif

Loin d’être un frein, le dialogue social autour de l’IA peut devenir un levier stratégique :

- 🤝 Facilite l’acceptation des technologies par les équipes.

- 💡 Permet d’identifier en amont les risques et biais.

- 🚀 Renforce l’image d’entreprise responsable et innovante.

C’est une vraie transformation dans la gouvernance d’entreprise qui intègre l’éthique technologique au cœur de sa stratégie et façonne une innovation juridique juste et durable.

À lire également :

ChatGBT : L’intelligence artificielle qui transforme vos erreurs en idées innovantes

Tu tapes “ChatGBT” au lieu de “ChatGPT” et tu crois avoir tout faux. Mauvais réflexe. Cette petite faute dit surtout une chose: tu veux aller…

Entreprises technologiques : comment anticiper et piloter la gouvernance de l’IA

Les sociétés spécialisées dans les technologies affrontent un défi majeur : intégrer la réglementation de l’IA dès la conception des projets pour s’éviter des déconvenues coûteuses. L’ordonnance de Nanterre fait la démonstration que la méconnaissance des règles sur le dialogue social peut immobiliser un projet et fragiliser son lancement.

Les conseils opérationnels pour maîtriser l’innovation juridique

Voici une checklist rapide pour piloter sereinement la gouvernance de l’intelligence artificielle :

- 🗂️ Constituer un dossier clair, précis et accessible mentionnant finalité et impact.

- 🧑💻 Associer les DRH et les juristes dès l’élaboration du projet.

- ⏳ Prévoir un calendrier intégrant consultation et retour du CSE.

- 🔄 Mettre à jour régulièrement la documentation avec les évolutions du système.

- 📊 Former les équipes sur les enjeux réglementaires et éthiques.

Ne pas sous-estimer la capacité du comité social à bloquer ou retarder un déploiement. Une gouvernance transparente évite les mouvements sociaux et crédibilise l’entreprise face à ses partenaires.

Les risques d’une mauvaise gestion juridique de l’IA

Sans une attention rigoureuse, les projets d’IA risquent :

- ⚠️ De faire l’objet de suspensions judiciaires.

- ⚠️ D’entraîner des sanctions financières lourdes.

- ⚠️ De ternir durablement la réputation de la marque.

- ⚠️ D’engendrer un climat social dégradé avec démotivation des salariés.

La clé est donc dans la conformité légale et l’anticipation, sous peine de recettes coûteuses à corriger une fois le déploiement engagé. C’est une question de stratégie, pas juste de maîtrise technique.

L’éthique et la protection des travailleurs au cœur de la régulation IA

La complexité du déploiement de l’IA en entreprise ne réside pas uniquement dans la technologie. La jurisprudence souligne la nécessité d’intégrer une éthique technologique solide pour protéger les droits des salariés et garantir un usage responsable.

Quelles dimensions éthiques pour les entreprises innovantes ?

La réglementation impose notamment que l’utilisation d’algorithmes ne porte pas atteinte aux droits fondamentaux :

- 👁️🗨️ Droit à l’information et transparence sur les traitements automatisés.

- ⚖️ Respect de la non-discrimination et lutte contre les biais algorithmiques.

- 🔒 Protection renforcée des données personnelles sensibles.

- 🙏 Prévention des effets délétères sur la santé mentale des salariés (monitoring excessif, pression accrue).

L’entreprise a la responsabilité de mettre en place des mécanismes de contrôle et d’accompagnement pour garantir ces principes, sous peine de voir les juges sanctionner sévèrement leur manquement.

| Enjeux éthiques ⚖️ | Actions recommandées 🛠️ | Risques en cas de non-respect 🚨 |

|---|---|---|

| Transparence et information | Communication claire et régulière aux salariés | Conflits sociaux, recours rares mais coûteux |

| Lutte contre les biais | Audit régulier des algorithmes | Discrimination, poursuites judiciaires |

| Protection des données | Renforcement de sécurité, contrôle d’accès | Amendes CNIL, perte de confiance |

| Bien-être des salariés | Mise en place de dispositifs de soutien | Absentéisme, burn-out, dégradation du climat |

Dans ce contexte, l’éthique technologique ne doit pas être considérée comme une contrainte, mais comme une opportunité pour renforcer l’image et la viabilité des entreprises dans la nouvelle décennie.

Jurisprudence numérique et perspectives 2025 : un droit de l’IA en mouvement constant

La décision de Nanterre ne sera probablement qu’une première étape dans l’évolution rapide du droit appliqué à l’intelligence artificielle en milieu professionnel. De nombreux dossiers sont en cours, témoignant de la montée en puissance des enjeux liés à la transition numérique et à la responsabilité des entreprises.

Les tendances majeures et défis juridiques à suivre

En matière de jurisprudence numérique, plusieurs axes se dessinent :

- 🚩 Renforcement des protections pour les salariés face aux systèmes d’IA.

- 🧩 Clarification des responsabilités dans la chaîne décisionnelle, notamment en cas de dommage.

- 🌐 Adaptation des régulations pour couvrir les nouvelles technologies (IA générative, deepfakes, etc.).

- 🔎 Multiplication des recours par les acteurs sociaux et syndicats.

La France s’inscrit dans une dynamique européenne et internationale où la régulation de l’IA devient un champ d’innovations juridiques complexe mêlant protection des droits, éthique technologique et développement économique.

Un paysage juridique en pleine mutation

Les entreprises devront se montrer proactives et agiles, en suivant attentivement les évolutions légales et en adaptant leurs pratiques. Le dialogue social, renforcé par cette jurisprudence, s’affirme comme un garde-fou essentiel pour éviter les excès et garantir un équilibre entre innovation et respect des personnes.

| Élément clé 🔑 | Tendance 2025 📈 | Conséquences pratiques 🎯 |

|---|---|---|

| Dialogue social renforcé | Obligation de consultation systématique avant déploiement | Meilleur acceptation, moins de blocages |

| Responsabilité des entreprises | De plus en plus engageante, sanctions accrues | Investissements dans la conformité |

| Innovation juridique | Multiplication des jurisprudences en IA | Nécessité d’une veille juridique constante |

| Protection des données | Normes renforcées et exigences éthiques | Amélioration de la gouvernance des données |

Pour les entreprises technologiques, suivre cette évolution est autant une obligation qu’une occasion unique de bâtir des solutions IA éthiques et fiables, garantes d’un avantage concurrentiel durable sur le marché.

FAQ – Questions fréquentes sur la jurisprudence IA en entreprise

- Quand doit-on consulter le CSE pour un projet IA ?

La consultation est obligatoire dès la phase pilote ou d’expérimentation si le projet impacte les conditions de travail des salariés. - Quelles sont les sanctions en cas de non respect ?

Suspension du projet, astreinte financière, dommages pour atteinte aux prérogatives du CSE et frais de justice. - Comment garantir la protection des données dans l’IA ?

En appliquant les règles RGPD adaptées à l’IA, en documentant les traitements et en assurant la transparence auprès des salariés. - Le dialogue social peut-il ralentir un projet IA ?

Oui, mais bien piloté il permet d’éviter des blocages coûteux et d’améliorer l’acceptabilité des outils. - Quels sont les enjeux éthiques majeurs liés à l’IA en entreprise ?

Transparence, lutte contre les biais, protection des données, respect du bien-être des salariés.

Moi c’est Mariane (avec un seul “n”).

J’ai troqué les process corporate contre des contenus qui claquent (et qui rankent).

Passionnée par le business en ligne, le SEO et l’IA, je transforme les idées floues en stratégies digitales qui font du bruit là où ça compte : dans les résultats. Je crois qu’avec un peu de tech, beaucoup d’audace, et une bonne dose de clarté, on peut faire exploser bien plus que des KPI.